Sự Trỗi Dậy của Mô Hình Ngôn Ngữ Lớn (LLM) và Xu Hướng Chạy Mô Hình AI trên Máy Tính Cá Nhân

Sự phát triển của các mô hình ngôn ngữ lớn (LLM) đang diễn ra với tốc độ chóng mặt. Mặc dù các dịch vụ trí tuệ nhân tạo (AI) được cung cấp trên nền tảng đám mây mang đến nhiều tiện ích, việc triển khai và vận hành LLM trực tiếp trên máy tính cá nhân lại sở hữu những lợi thế đáng kể.

Những ưu điểm này bao gồm việc tăng cường tính bảo mật cho dữ liệu, khả năng hoạt động ngay cả khi không có kết nối internet, cũng như quyền kiểm soát hoàn toàn đối với dữ liệu và quá trình tùy chỉnh mô hình.

Khám Phá TOP Công Cụ LLM Tốt Nhất Cho Việc Chạy Mô Hình AI Trên Máy Tính

Bài viết này sẽ đi sâu vào việc đánh giá và so sánh các công cụ LLM hàng đầu, được thiết kế để chạy các mô hình AI một cách hiệu quả trên máy tính cá nhân.

Chúng ta sẽ phân tích chi tiết điểm mạnh và điểm yếu của từng công cụ, nhằm cung cấp thông tin hữu ích để bạn có thể đưa ra lựa chọn phù hợp nhất với nhu cầu của mình.

LLM Cục Bộ: Định Nghĩa và Ưu Điểm

LLM, viết tắt của Large Language Model, hay mô hình ngôn ngữ lớn, đại diện cho một hình thức trí tuệ nhân tạo (AI) tiên tiến.

Các mô hình này được đào tạo bằng cách tiếp xúc với một lượng khổng lồ các dữ liệu văn bản, bao gồm sách, báo, nội dung website và mã nguồn, nhằm mục đích nắm bắt và tái tạo khả năng sử dụng ngôn ngữ tự nhiên của con người.

Trong thực tế, phần lớn người dùng hiện nay tiếp cận LLM thông qua các dịch vụ đám mây (cloud). Một ví dụ điển hình là ChatGPT, hoạt động trên cơ sở hạ tầng máy chủ của OpenAI.

Điều này có nghĩa là mọi thông tin đầu vào đều được truyền tải lên máy chủ để tiến hành xử lý. Tuy nhiên, LLM cục bộ mang đến một phương thức tiếp cận khác biệt.

Với LLM cục bộ, người dùng có thể tải xuống và triển khai mô hình trực tiếp trên thiết bị máy tính cá nhân của mình, loại bỏ sự phụ thuộc vào kết nối internet và máy chủ bên ngoài.

Ưu điểm của việc triển khai LLM trên thiết bị cá nhân

Một trong những lợi ích hàng đầu khi vận hành các Mô hình Ngôn ngữ Lớn (LLM) trực tiếp trên máy tính cá nhân là khả năng đảm bảo bảo mật tuyệt đối. Toàn bộ dữ liệu được xử lý và lưu trữ hoàn toàn trong hệ thống của bạn, loại bỏ nguy cơ truyền tải thông tin ra bên ngoài.

Khả năng hoạt động offline cũng là một điểm cộng lớn. Bạn có thể tiếp tục sử dụng LLM ngay cả khi không có kết nối internet, điều này đặc biệt hữu ích ở những khu vực có hạ tầng mạng kém hoặc không ổn định.

Việc triển khai LLM cục bộ mang đến sự tùy chỉnh linh hoạt. Bạn có thể điều chỉnh và tinh chỉnh mô hình để đáp ứng chính xác các yêu cầu cụ thể, từ đó nâng cao hiệu suất và độ chính xác của AI.

Hơn nữa, việc tự vận hành LLM giúp tiết kiệm chi phí đáng kể. Thay vì phải trả các khoản phí định kỳ cho các dịch vụ đám mây, bạn chỉ cần đầu tư ban đầu và duy trì hệ thống, về lâu dài sẽ tiết kiệm hơn.

TOP công cụ LLM tốt nhất

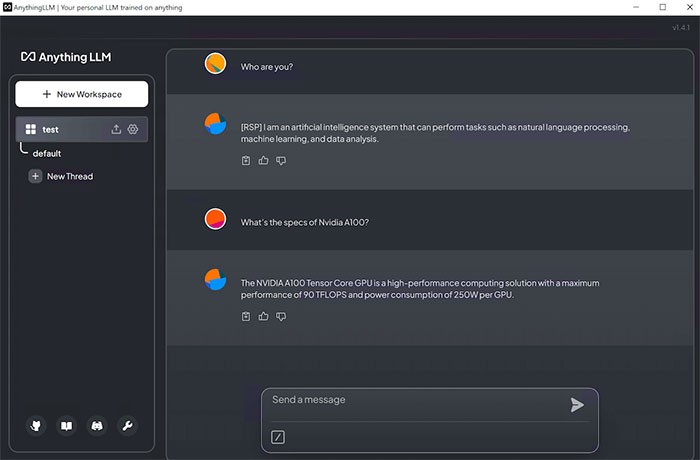

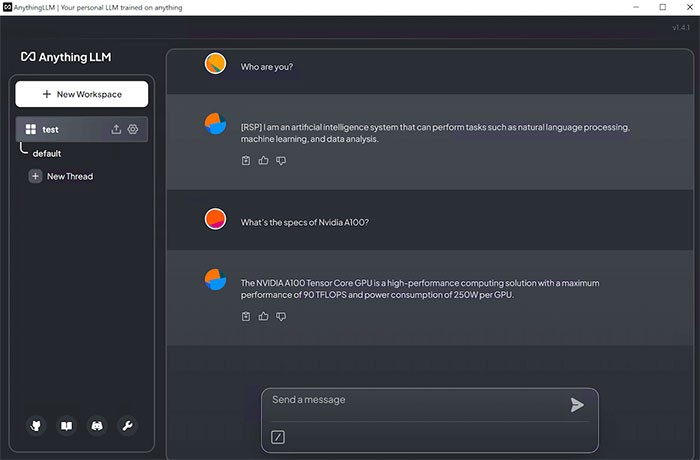

AnythingLLM

AnythingLLM là một ứng dụng AI mã nguồn mở, mang đến khả năng vận hành các mô hình ngôn ngữ lớn (LLM) trực tiếp trên máy tính cá nhân của bạn. Nền tảng này hoàn toàn miễn phí và cung cấp các tính năng sau:

- Khả năng tương tác với các tài liệu như PDF, Word, hoặc mã nguồn.

- Chức năng tự động hóa thông qua việc chạy các AI agent.

- Xử lý đa dạng các tác vụ AI một cách hoàn toàn độc lập, không cần kết nối internet.

- Kiến trúc của AnythingLLM được xây dựng trên ba thành phần chính:

- Giao diện React, đảm bảo trải nghiệm tương tác mượt mà.

- Server NodeJS Express, quản lý cơ sở dữ liệu vector và kết nối đến các LLM.

- Server xử lý tài liệu chuyên biệt.

Ưu điểm nổi bật của AnythingLLM chính là khả năng kiểm soát và bảo mật dữ liệu, vì mọi thông tin đều được xử lý tại chỗ và không được truyền ra bên ngoài. Với phiên bản Docker, việc triển khai cho nhiều người dùng và phân quyền truy cập trở nên dễ dàng, đồng thời vẫn đảm bảo an toàn tuyệt đối. Hơn nữa, các tổ chức có thể tiết kiệm chi phí liên quan đến API bằng cách tận dụng các mô hình mã nguồn mở miễn phí.

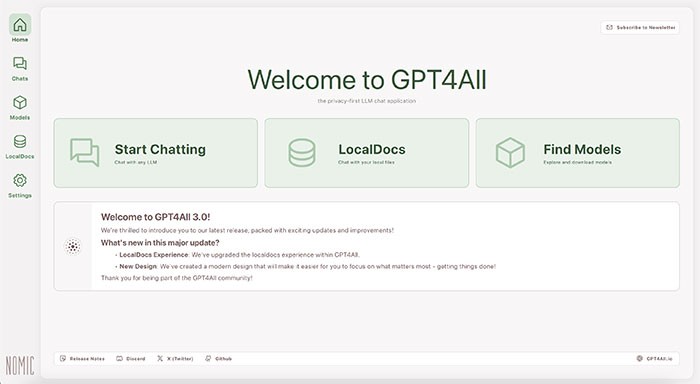

GPT4All

GPT4All cho phép bạn chạy các mô hình LLM trực tiếp trên máy tính cá nhân, mà không cần phải gửi bất kỳ dữ liệu nào lên cloud.

- Phiên bản miễn phí hỗ trợ hơn 1.000 mô hình mã nguồn mở khác nhau, bao gồm LLaMa và Mistral.

- Phần cứng tương thích: Chạy tốt trên các máy Mac M Series, AMD, NVIDIA, và không yêu cầu kết nối internet.

- Tính năng LocalDocs: Phân tích tài liệu cá nhân và xây dựng cơ sở tri thức riêng ngay trên thiết bị của bạn.

- Hỗ trợ cả CPU và GPU, tận dụng tối đa tài nguyên phần cứng hiện có.

Bằng cách xử lý hoàn toàn dữ liệu nội bộ, GPT4All đáp ứng các yêu cầu bảo mật nghiêm ngặt, đặc biệt quan trọng trong môi trường doanh nghiệp.

Ollama

Ollama là một công cụ mã nguồn mở, được thiết kế để giúp bạn tải, quản lý và chạy các mô hình LLM trực tiếp trên máy tính mà không cần phải kết nối đến cloud.

- Hỗ trợ cả giao diện dòng lệnh (command line) và giao diện đồ họa.

- Tương thích với các hệ điều hành macOS, Linux và Windows.

- Cung cấp một kho mô hình đa dạng, bao gồm Llama 3.2 (xử lý văn bản), Mistral (tạo code), Code Llama (lập trình), LLaVA (xử lý hình ảnh) và Phi-3 (nghiên cứu khoa học).

- Mỗi mô hình chạy trong một môi trường riêng biệt, giúp bạn dễ dàng chuyển đổi giữa các mô hình theo nhu cầu.

Việc sử dụng Ollama có thể giúp giảm chi phí cloud, hỗ trợ các dự án chatbot, nghiên cứu khoa học, hoặc các ứng dụng AI xử lý dữ liệu nhạy cảm, đồng thời đảm bảo dữ liệu được lưu trữ tại chỗ và tuân thủ các quy định về bảo mật như GDPR.

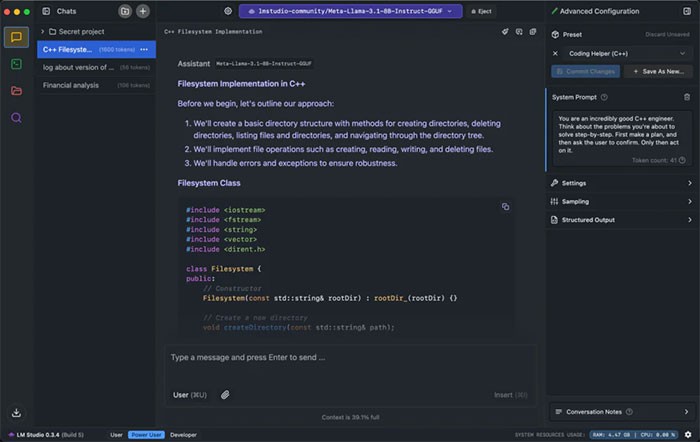

LM Studio

LM Studio là một ứng dụng desktop, cho phép bạn chạy các mô hình LLM trực tiếp trên máy tính và cung cấp một giao diện người dùng tiện lợi.

- Người dùng có thể tìm kiếm, tải xuống và chạy các mô hình từ Hugging Face.

- API mô phỏng OpenAI: Cho phép kết nối các AI cục bộ vào các công cụ vốn hỗ trợ OpenAI.

- Hỗ trợ nhiều loại mô hình lớn, bao gồm Llama 3.2, Mistral, Phi, Gemma, DeepSeek và Qwen 2.5.

- Cho phép trò chuyện trực tiếp với tài liệu thông qua công nghệ RAG (Retrieval Augmented Generation).

- Tất cả các quá trình xử lý đều diễn ra offline, đảm bảo không có dữ liệu người dùng nào được thu thập.

Tuy nhiên, để chạy LM Studio một cách hiệu quả, máy tính của bạn cần có CPU, RAM và dung lượng lưu trữ đủ lớn. Việc mở nhiều mô hình cùng lúc có thể gây ra tình trạng chậm trễ.

Xem thêm: Top LLM Tools to Run AI Models on Your Computer .